在著名动漫《新世纪福音战士》里,碇源堂和他背后的SEELE组织始终在执行一项叫做“人类补完计划”的神秘行动。这个计划到底是什么意思

在著名动漫《新世纪福音战士》里,碇源堂和他背后的SEELE组织始终在执行一项叫做“人类补完计划”的神秘行动。

这个计划到底是什么意思,粉丝们已经争吵了很多年。但大体上应该是说利用“神性”来补完人类族群,从而消除人类社会中的种种问题。也就是说,这个计划是“把人类补完的计划”。

但“人类补完”这个词,其实还可以有另一种解释,就是“用人类去补完某种东西的计划”。有东西需要用人类来补完吗?当然有,比如说人工智能。

号称AI研发实力地球第一的DeepMind,似乎就在执行着这样一个“计划”。我们知道,相比于大部分兴趣广泛的AI实验室型企业,DeepMind的专注点非常整齐。基本可以形容为:左手游戏,右手神经学;向下关注医疗落地,向上思考AI道德。

这样的方向选择,与DeepMind创始人哈萨比斯的个人经历与兴趣紧密相关。游戏我们已经看到了围棋和《星际争霸2》。还没有引发公众关注的,是这位天才右手中攥着的,学习人类大脑与神经来发展高等级人工智能的宏伟野心。

有野心不可怕,可怕的是,在不到一年的时间里,这个计划已经初现规模。

“狂人”的战役

大概地球上不会有第二个人,能够同时擅长人工智能、游戏、神经科学、创业这四件事。

关于“神童”哈萨比斯的事迹,媒体已经有了太多报道。比如他5岁参加国际象棋正式比赛,16岁进入剑桥学习人工智能,22岁创办了电脑游戏公司,以及后面DeepMind的系列“神迹”。

但媒体比较少关注的一件事,是这个被万维网之父蒂姆·伯纳斯·李称为“星球上最聪明的人之一”的人工智能专家,博士学位修的是认知神经科学。

2005年,已经沉浸人工智能多时的哈萨比斯,决定回到象牙塔中充电。在伦敦大学学院攻读神经学中,哈萨比斯发现了大脑海马体与人类情景记忆的关系。这固然是个关于人类记忆的重要发现,但要注意的是,其同时也影响了接下来很长一段时间内关于机器记忆的研究,尤其是在机器学习中的连续学习和长期学习。

其实在上世纪四五十年代,研究机器智能的专家,很多来自于神经科学与社会行为学。毕竟所谓人工智能,归根结底目标是让机器产生类似人类智慧的能力。但随着后来人工智能与计算机科学的联系日间紧密,神经科学也回到了生物学的研究序列中。

几十年间二者各自飞速发展,研究人员也越来越“专业”。直到统计学和数学开始笼罩AI研究,人工智能的底层研究似乎很大程度上变成了纯碎的函数问题。

显然,据说5岁就开始思考人工智能问题的哈萨比斯,对这种现象是非常不满的。DeepMind成立初期,始终在忙着让AI打游戏和完成棋类运动。而在2017年,AlphaGo终于无敌于天下,哈萨比斯却没怎么享受胜利果实,而是马不停蹄开始了一项长期计划的号召:人工智能必须继续向神经科学取经。

去年7月,哈萨比斯非常少见的亲手写下长篇文章,并且不是像往常一样发表在人工智能刊物,而是发表在了神经医学界的最高规格刊物《神经》中。

这篇《神经科学启发人工智能》,完全可以看做是一篇檄文。文中哈萨比斯开宗明义地表示,假如我们的目标是开发出接近或同等于人类智慧的智能技术,那么就绝不能放弃对人脑的研究和理解,因为人脑是唯一能够证明这种智慧存在的证据。同时他还历数了强化学习、迁移学习等10个神经科学可以启发AI研究的领域。

在哈萨比斯看来,今天学术界的过于封闭,已经限制了AI研究的发展。目前神经科学对人工智能的影响,更多来自于微妙的启发和科研成果借鉴,缺乏AI与神经科学的系统性结合,缺乏双向人才(比如哈萨比斯自己),更缺少两个领域有效、直接的沟通。所以他呼吁培养跨领域人才,希望建立共同的理论体系、话语机制和跨学科研究项目。

当然了,只呼喊不实干从来不是DeepMind与哈萨比斯的风格(事实上很少见到哈萨比斯如此努力呼吁某事)。在几个月时间里,DeepMind的科学家们已经浩浩荡荡把BOSS“学习神经科学”的主张实践了起来。

“科学狂人”这场“用人类补完AI”的战役,此刻已在高速运转中。

用成长心理学解释AI黑箱

去年6月,似乎为了与哈萨比斯的呼吁相配合,DeepMind团队发表了一篇论文,探讨用心理学中的某些现象和实验方法来解释AI的黑箱子问题。

我们知道,黑箱现象如今是困扰人类探索AI的主要问题之一。在经过复杂的神经网络计算之后,常常会出现人类无法搞懂算法的运作机制,不知道算法如何得出结论的问题。失控的机器智能当然不是好智能,但研究AI的判断与喜好却总是缺乏有效途径。

DeepMind的科学家们,想到了去心理学取经。心理学中有个专门学科,叫做成长心理学,研究幼儿成长过程中产生的心理、认知与记忆变化。这门学科中有个有意思的实验,是研究幼儿究竟是怎么记住兔子的?

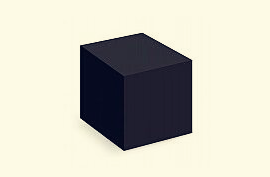

告诉孩子什么是兔子,再重新找一只兔子让他识别,他记住的是什么呢?是颜色?形状?还是局部特征?最终心理学实验表明,人类幼儿总是偏向于通过形状来记忆新事物。

从中受到启发,DeepMind对AI模型进行了类似的实验,首先让模型记住一个物体,然后一面调整物体的颜色,一面调整物体的形状。最终结果表明,深度学习网络也与人类有相似的偏好:更喜欢根据形状来识别对象。

这种偏好是此前的AI研究中没有发现的,虽然它不能完全解释黑箱,但却给理解AI开启了全新的思路。更重要的是,类似的心理学研究与实验还有太多。也就意味着给AI做心理实验是有效而价值巨大的。

换句话说,这项研究成果表示,哈萨比斯希望在今天用神经科学补强AI,似乎有门!

用强化学习理解人类大脑

在哈萨比斯看来,不仅AI需要向神经科学学习,对人类大脑与神经的研究,在今天也需要向AI学习。

强化学习,是今天AI前沿研究中最火热的议题之一。这门技术希望用强化信号,来反复向智能体输出奖励机制,从而让神经网络不断做出优化选择,建立最优决策机制。AlphaGo Zero就强调用强化学习来快速达成高度成熟的围棋能力。

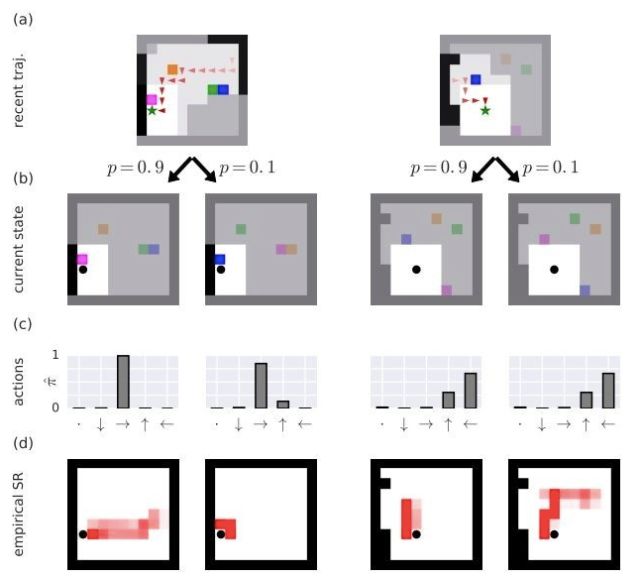

在9月和10月的两项研究中,DeepMind开启了全新脑洞:用强化学习机制来理解人类大脑。

比如在《自然》子刊《自然·人类行为》上发表的一篇论文中,DeepMind联合多院校的相关团队,一起探讨了人类决策行为时的后继表示(successor representation,SR)现象。实验结果显示,人类决策行为中,确实用到了缓存未来预期并映射到现实决策中的方案。这也是强化学习模式在人脑中工作的第一个证据。

另一篇发表在《自然神经科学》的论文中,DeepMind尝试用强化学习技术来探究人脑中海马体的工作方式。大脑中海马体能够作为空间定位器,负责帮人类认路,这已经是公认的事实。但是这样的解释却无法说明海马体是如何参与记忆、决策、推理等任务的。

DeepMind还是基于AI中强化学习技术的思路,设计了相关实验,来证明海马体的定位和指路能力,其实是一种有奖励机制和决策机制的强化学习过程。

相关证据表明,大脑海马体在指路中的作用,是建立在空间信息之上,对奖励最大化的选择。研究人员称其为“地图预测机制”。这也就解释了海马体参与其他人脑工作时的基本方式。

这两篇研究最有脑洞的地方在于:他们都是用强化学习机制来解释人脑的运作模式,并通过一些实验来证明自己的解释是正确的。同时又反过来阐释,假如人脑确实是以强化学习中的奖励机制来执行预测、记忆等基本智能。那么对人类大脑机制的研究与模仿,应该也可以加强对强化学习技术的理解和升级。

在同一个实验中,两个学科相互帮助携手进步,真的有点奇妙…

用心智理论,帮助机器理解彼此

如果说以上“用人类补完AI”的计划还停留在学术认识上,那么到了今年,DeepMind似乎已经准备好在AI技术本身放大招了。

就在上个月,DeepMind发表了他们如何让智能体理解智能体的研究“机器心智理论”(Machine Theory of Mind),并放出了相关模型。这毫无疑问意味着人类对AI可解释性的研究到了新的阶段。同时这也是我认为本文可以开始写作的原因之一。

什么是“心智理论”?

我们认为AI处于黑箱子中难以理解,但我们是怎么理解其他人类的呢?我们可以跟其他人交流,预测他人的行动和情感,甚至可以预测他人的消费行为...但我们没有把他们的大脑撬开,看里面的前额叶海马体脑皮层是如何工作的...原因就在于,我们是通过心智理解他人和自己的行为与情感。这就是心理学上的心智理论。

DeepMind希望利用这个心理学概念,让智能体观察和学习其他智能体的动作与行为,从而准确预测被观察者下一步的动作。通过不同等级智能体的观察实验,论文中已经展示出ToMnet理解并预测不同层级、不同底层技术智能体的能力。

换句话说,这项技术突破让AI成功的通过外部行动来理解AI,而不必将内在架构链接在一起。

事情到了这里,已经弥漫出一点失控的味道。假如未来机器可以像人类一样,通过交谈和行为理解彼此,那与人类好像也没多大不同了。

根据最近各方面的反馈看,机器心智理论(Theory of Mind neural network)——ToMnet的价值,很有可能不低于历史上任何一项人工智能技术突破。虽然有专家批评ToMnet并非是建立在知识空白的基础上去理解其他智能体,但这项技术突破的价值还是被广泛承认。

很多专家预测,接下来多智能体协同系统,机器交互,AI自我成长,这些关键领域很可能都要以ToMnet作为基础。

而这个突破的根源,却是来自心理学。

战鼓初鸣:关于补完计划的进度

让我们来总结一下哈萨比斯这场“用神经科学强化AI”行动的进度吧。

目前DeepMind相关研究专注于两个方面:强化学习、AI可解释性。整体研究围绕这两项技术来展开,既用心理学和神经科学来加强对AI黑箱的破解,同时也希望用强化学习等“AI原理”帮助探秘人类大脑。

整个计划的最大成绩,在于给跨学科研究做出了扎实的示范,证明了用神经学补全AI的可行性。非常关键的机器心智理论很可能带来惊喜,成为主流研究方向。而对于强化学习的探索,可能与机器决策、物理世界处理等AI领域的技术相结合。

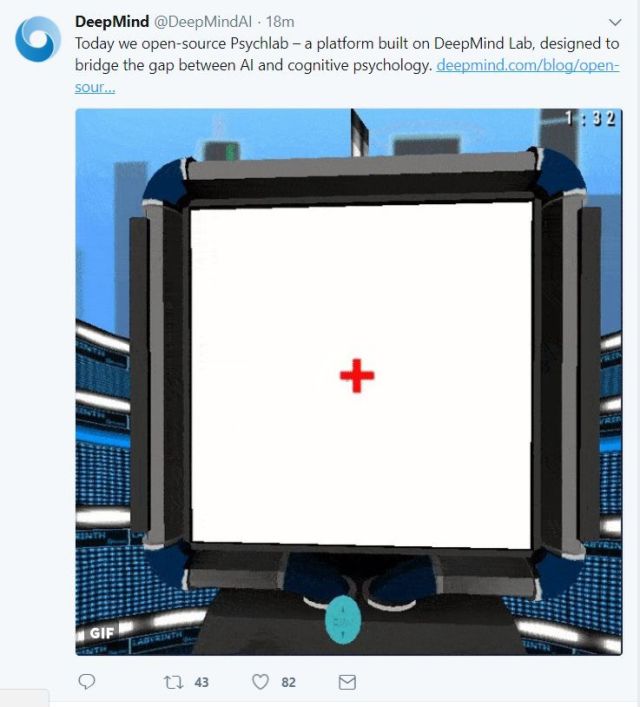

还有一点值得注意,DeepMind开源了Psychlab平台。这是一个“智能体专用心理测试集”,可以让更多研究者尝试AI与心理学的结合。

整个计划也不是没有问题。比如哈萨比斯一度呼吁搭建双学科理论框架和标准学术话语,今天依旧未见踪影。由于没有带来极其惊人的大动作,大众对于这类技术所知也不多。此外,虽然哈萨比斯曾经怀疑过这一现象,但直到今天,神经科学与认知心理学对AI的影响依旧主要是启发性的,缺乏前沿技术成果的相互关照。

而放眼未来,与记忆相关的AI技术或许会成为DeepMind的研究重点。情景记忆、工作记忆、长期学习等技术很有可能成为突破方向。

最重要的是,2018年,我们很大概率会看到哈萨比斯在AI模仿人类神经与心智上搞个轰动社会舆论的“大动作”出来。

还有一个问题,哈萨比斯和DeepMind如此坚定地推动AI向神经科学学习,终极目的仅仅是为了强化AI技术吗?

在去年《神经》杂志上那篇形同宣言的文章中,哈萨比斯曾在结尾处畅想:通过人工智能来了解人类智慧,让人工智能与人类大脑形成比对,或许有可能“对人类心灵中一些最深刻和最持久的奥秘产生深刻的见解,例如创造力、梦想,甚至有一天能触及意识的本质。”

真至于此,是不是同样喜欢戴黑框眼镜的哈萨比斯和碇源堂,两个人的“人类补完计划”,也就没有什么不同了?